Uanset om det er Siri, Cortana eller Google Assistant, har AI-assistenter været til stede på smartphones i nogen tid nu. Og med den hurtige udvikling af kunstig intelligens-teknologier på alle domæner, vil disse assistenter kun blive bedre med tiden.

Det første eksempel, vi har på dette, er Googles Gemini, som har erstattet Google Assistant på Android-smartphones som standard AI-assistent. Mens tidligere Gemini var ret begrænset i, hvad den kunne gøre sammenlignet med Google Assistant, annoncerede Google for nylig store opdateringer til den, der vil gøre chatbotten utrolig kraftfuld og mere nyttig.

Dette gælder især for Gemini Nano, som blev annonceret på Pixel 8-telefoner og Samsung Galaxy S24 tilbage i januar. Her er, hvordan Google planlægger at opdatere denne model, så den bliver endnu bedre.

Geminis kontekstbevidsthed får en stor forbedring

Som andre chatbots kan Gemini normalt forstå den kontekst, du interagerer med den i, selvom dette ikke altid er tilfældet. Derfor er en af de vigtigste ændringer, der kommer til det, en væsentlig forbedring af dens kontekstuelle bevidsthedsevner.

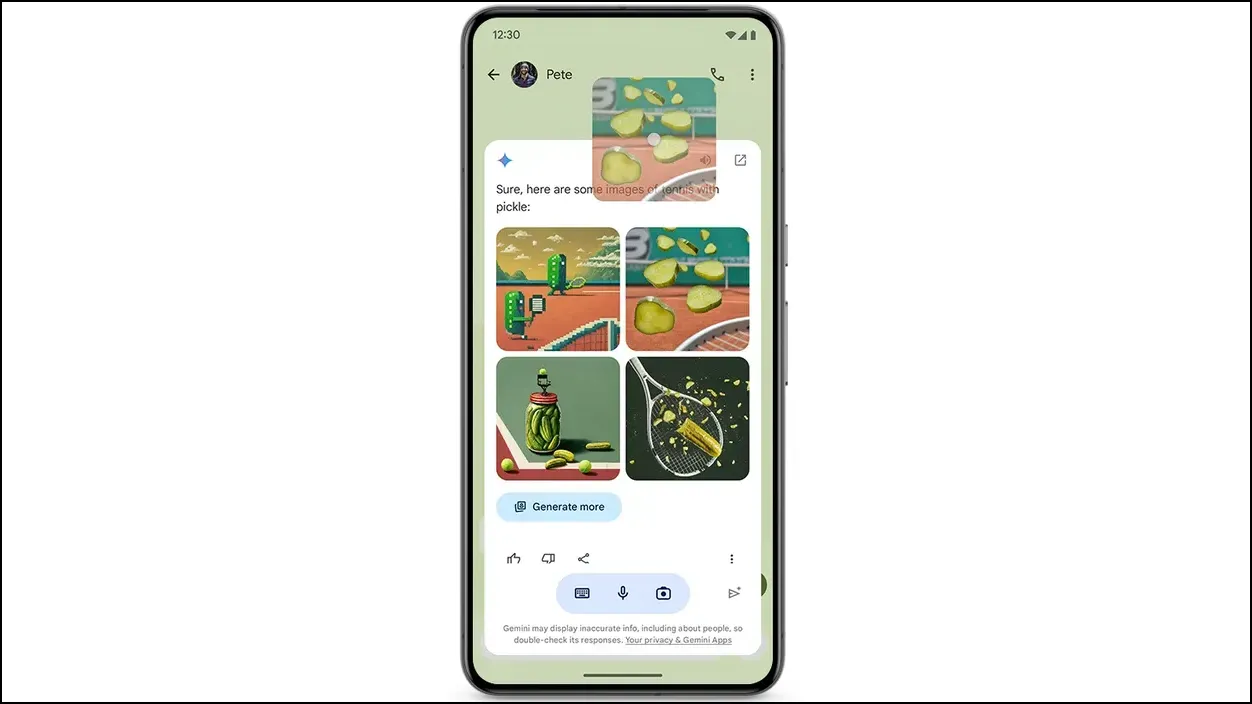

Gemini kan nu nemt forstå, hvad der foregår på din skærm og endda den applikation, du muligvis bruger på et givet tidspunkt. Ifølge Google vil brugere være i stand til at hente Gemini-overlayet og bruge AI, mens de bruger en anden app på samme tid. For eksempel kan du generere billeder med Gemini og direkte trække og slippe dem til Google Beskeder, Gmail eller en anden app.

Et andet eksempel er, når du ser en YouTube-video, kan du bruge Geminis ‘Spørg denne video’-funktion til at få information fra den video. Dette svarer til Gemini Advanced’s ‘Spørg denne PDF’-funktion, som kan hjælpe dig med at få information hurtigt fra en PDF uden at skulle læse den helt igennem.

Endelig er der dynamiske forslag, som Gemini vil tilbyde ved at tjekke din skærm. Dette kan endda ske, uden at du behøver at skrive noget, da Gemini automatisk vil forstå konteksten for det, du arbejder på.

Hvis du for eksempel har en samtale i Google Beskeder om at tage en kop kaffe, kan Gemini automatisk anbefale de bedste kaffebarer i nærheden af dig i Google Maps.

Brugere vil snart kunne få adgang til Gemini fra dets overlejringspanel, som vil være til stede, selv mens de giver resultater, så du ikke behøver at åbne det i fuldskærmstilstand hver gang.

Gemini Nano for at få fuld multimodal kapacitet

Indtil nu har Gemini stolet på tekst- eller stemmebaserede input for at forstå en brugers forespørgsel og give relevante svar. Nu opgraderer Google sine muligheder og kalder det Gemini Nano med Multimodality. Dette skyldes, at den opdaterede model også kan bruge billeder, talte sprog og lyde til at forstå, hvad en bruger ønsker.

Dette er en enorm, men meget velkommen opgradering og vil drastisk ændre, hvad smartphones med AI-assistenter kan gøre. Du vil være i stand til at bruge din Pixel-smartphone til at få information fra dine omgivelser gennem kameraet og mikrofonen i stedet for blot at stole på tekst.

Circle to Search er blevet opdateret for at hjælpe eleverne

Tilbage i januar annoncerede Google en ny funktion til udvalgte Android-smartphones – Circle To Search, som lader dig bruge en simpel gestus til at søge efter information uden at forlade den app, du bruger. Dette fungerer med multisøgning, så du kan bruge både billeder og tekst til at stille Google et spørgsmål om alt på din skærm.

Siden lanceringen er Circle To Launch blevet opdateret med funktioner som fuldskærmsoversættelse, men på sin I/O-udviklerkonference annoncerede Google endnu en opdatering. Det kan nu hjælpe eleverne med deres lektier ved at hjælpe dem med at løse matematik- og fysikproblemer nemt.

Eleverne skal blot sætte en ring om det problem, de vil have hjælp til, og Gemini vil give dem de trin, de skal følge for at få svaret.

Google annoncerede også, at Circle To Search snart endda vil være i stand til at hjælpe med at løse komplekse problemer, der involverer grafer, diagrammer, formler og mere. Google udvider også funktionen til flere Pixel- og Samsung-smartphones.

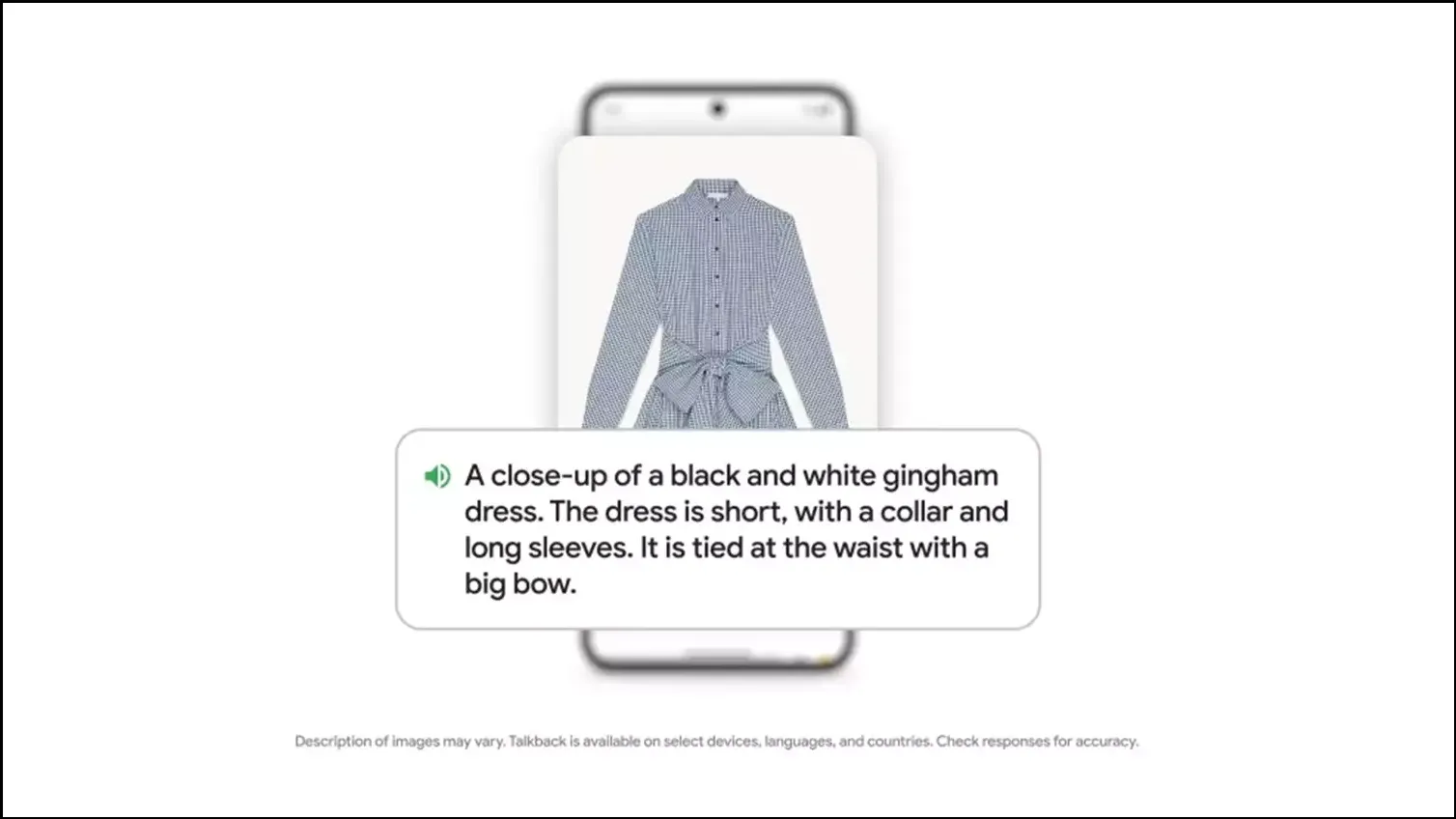

Talkback vil give bedre beskrivelser

Talkback er en Android-funktion designet til at hjælpe mennesker med synshandicap ved at forklare, hvad der bliver vist på deres smartphones skærme. Med Gemini Nano, der får multimodale muligheder, bliver Talkback også meget bedre til at beskrive objekter og elementer.

Det, der er mest imponerende ved dette, er, at det fungerer, selv når din enhed er offline. Den opdaterede Gemini Nano-model kan tilbyde beskrivelser, der vil være meget lig, hvad et menneske ville give, hvilket gør det meget mere nyttigt sammenlignet med, hvordan Talkback fungerer lige nu.

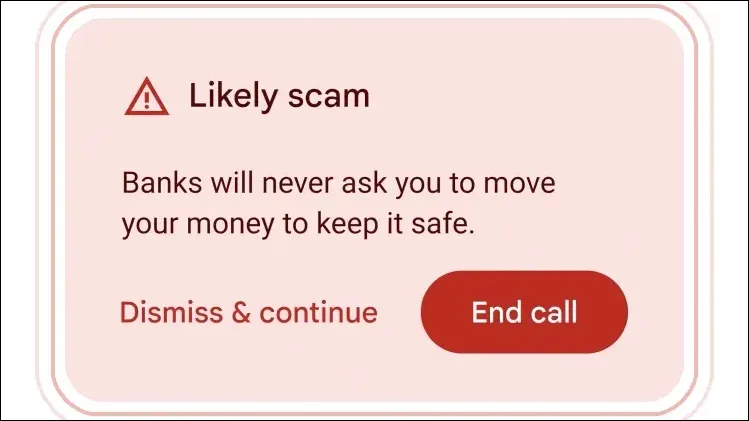

Gemini kan nu advare dig om svindelopkald

Efterhånden som svindelbeskyttelse er blevet mere robust med årene, er svindelopkald også blevet mere sofistikerede. Så på trods af disse beskyttelser undlader mange mennesker stadig at skelne svindelopkald fra ægte. Det er grunden til, at Google tester en ny funktion, der vil lade Gemini Nano levere advarsler i realtid for svindelbeskyttelse.

Det vil være i stand til at opdage mønstre i samtaler, der normalt er til stede i svindelopkald og advare dig med det samme. For eksempel, hvis du får et opkald fra en, der hævder at være en bankrepræsentant, der beder dig om at overføre penge eller noget i samme retning, får du en advarsel. Og da dette er beskyttelse på enheden, bliver dit privatliv ikke kompromitteret.

Gemini Nano blev introduceret med Pixel 8-telefonserien og Samsung Galaxy S24 tidligere på året. Den opdaterede model forventes at komme på Pixel-telefoner senere i år, mens funktioner som fupopkaldsadvarsler vil finde vej til alle Android-enheder.

Med disse opdateringer gør Google Gemini mere kraftfuld og bedre til at være en virtuel assistent, der kan hjælpe dig, når du har brug for det. De fleste af disse funktioner vil dog være begrænset til flagskibstelefoner, i det mindste for nu, så vi kan blive nødt til at vente et stykke tid for at se dem på andre enheder.

Skriv et svar