En anden AI-model har sluttet sig til havet af AI-modeller, og denne er fra OpenAI igen. OpenAI udgav tidligere GPT-4o i år, som skulle være mere effektiv end GPT-4. Men det var stadig ret dyrt og kunne skaffe en hel regning, især for udviklere, der har brug for at kalde AI-modellen gennem API’et til deres apps gentagne gange i løbet af dagen.

Som et resultat vendte udviklere sig til billigere små AI-modeller fra konkurrenter, som Gemini 1.5 Flash eller Claude 3 Haiku.

Nu udgiver OpenAI GPT-4o mini, deres hidtil mest omkostningseffektive model, hvormed de også går ind i det lille AI-modelrum. Mens GPT-4o mini er deres billigste model endnu, opnår den ikke så lave omkostninger ved at skære ned på intelligensen; den er smartere end deres eksisterende GPT-3.5 Turbo-model.

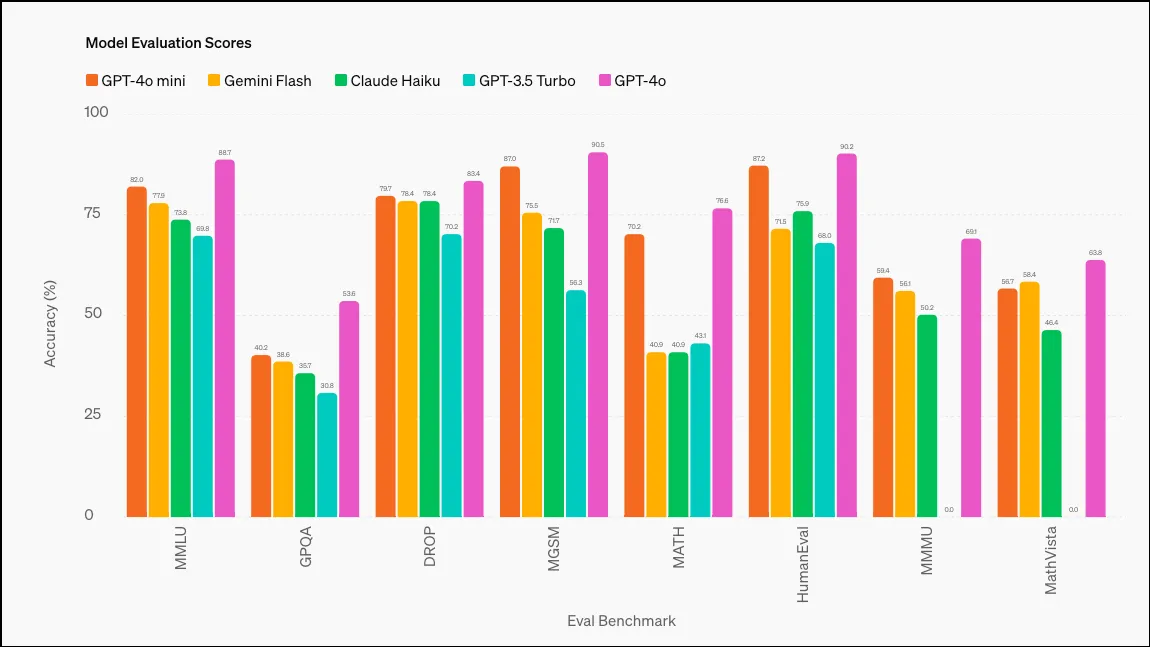

Ifølge OpenAI scorede GPT-4o mini 82 % i MMLU (Measuring Massive Multitask Language Understanding), hvilket overgik mange modeller; disse er de respektive resultater for forskellige modeller: GPT-3,5 Turbo (70 %), Claude 3 Haiku (75,2 %) og Gemini 1,5 Flash (78,9 %). GPT-4o scorede 88,7% på dette benchmark, med Gemini Ultra med den højeste score – 90% (dette er dog ikke små AI-modeller).

GPT-4o mini bliver rullet ud til ChatGPT Free, Team og Plus-brugere samt udviklere i dag. For ChatGPT-brugere har den i det væsentlige erstattet GPT-3.5; GPT-4o mini vil være den model, samtalen som standard indstiller til, når du løber tør for gratis GPT-4o-forespørgsler. Udviklere vil stadig have mulighed for at bruge GPT-3.5 gennem API’et, men det vil i sidste ende blive droppet. ChatGPT Enterprise-brugere får adgang til GPT-4o mini i næste uge.

Som nævnt ovenfor er fokus for GPT-4o mini at hjælpe udviklere med at finde en lavpris- og latensmodel til deres app, der også er i stand. Sammenlignet med andre små modeller udmærker GPT-4o mini sig til ræsonneringsopgaver i både tekst og vision, matematiske ræsonnementer og kodningsopgaver samt multimodale ræsonnementer.

Det understøtter i øjeblikket både tekst og vision i API’et, med understøttelse af tekst, billede, video og lyd input og output på køreplanen for fremtiden.

GPT-4o mini har et kontekstvindue på 128.000 tokens til input og 16.000 tokens til output pr. anmodning, med dens viden op til oktober 2023. Den kan også håndtere ikke-engelsk tekst ret omkostningseffektivt.

Skriv et svar