Google annoncerede for nylig en række opdateringer til sin Gemini AI-model, herunder flere opgraderinger og nye modeller. Blandt disse var en, der fik stor opmærksomhed, Gemini Live, en multimodal AI-model, der har video- og stemmefunktioner.

Siden Bard blev omdøbt til Gemini i februar, har AI-modellen tjent som erstatning for Google Assistant på Android-enheder. Det er dog ret begrænset i, hvad det kan i øjeblikket. Med Gemini Live sigter Google mod at ændre dette ved at tilbyde en mere kraftfuld og alsidig AI-model.

Hvad er Gemini Live?

For at give brugerne en forbedret AI-oplevelse og for at tage imod OpenAIs GPT-4o forbedrede ChatGPT, annoncerede Google Gemini Live på sin I/O-udviklerkonference for nylig. Gemini Live giver brugerne mulighed for at have naturlige og personlige samtaler i realtid med det gennem stemme og senere video.

Den nye AI-model er en del af Googles Project Astra, som er søgegigantens forsøg på at bygge en universel AI-assistent, der kan bruge forskellige typer input fra hverdagen til at yde assistance. For eksempel kan Gemini Live bruge tekst, billeder fra dit smartphone-kamera og din stemme til at besvare spørgsmål.

Ifølge Google vil den nye naturlige sprogmodel ikke kun hjælpe brugerne med at løse problemer og udføre forskellige handlinger, men også føle sig helt naturlig under interaktioner. Brugere vil være i stand til at starte Gemini Live ved at trykke på stemmeikonet på deres telefon, som vil vise AI i fuldskærm med en lydbølgeformeffekt.

Du kan derefter tale med AI’en, ligesom du ville gøre med en rigtig personlig assistent. Et glimrende eksempel på, hvordan den opgraderede AI-model kan hjælpe dig, er, når du beder den om at hjælpe dig med at forberede et interview. Gemini Live vil foreslå de færdigheder, du kan fremhæve, give offentlige taler tips og mere.

Funktioner

Gemini Live kommer med et par funktioner, der gør det til en meget bedre AI-assistent end Google Assistant, Apples Siri eller Amazons Alexa.

Tovejs stemmesamtaler

Gemini Live lader dig tale med det og giver menneskelignende verbale svar, hvilket resulterer i engagerende og intuitive samtaler. For eksempel kan du spørge den om vejret, og det vil give dig en præcis og kortfattet opdatering.

Smart Assistant-funktioner

AI-modellen kan fungere som en smart assistent og udføre opgaver som at opsummere information fra e-mails og opdatere din kalender. Du kan for eksempel tage et billede af en koncertfolder, og Gemini tilføjer begivenheden til din kalender.

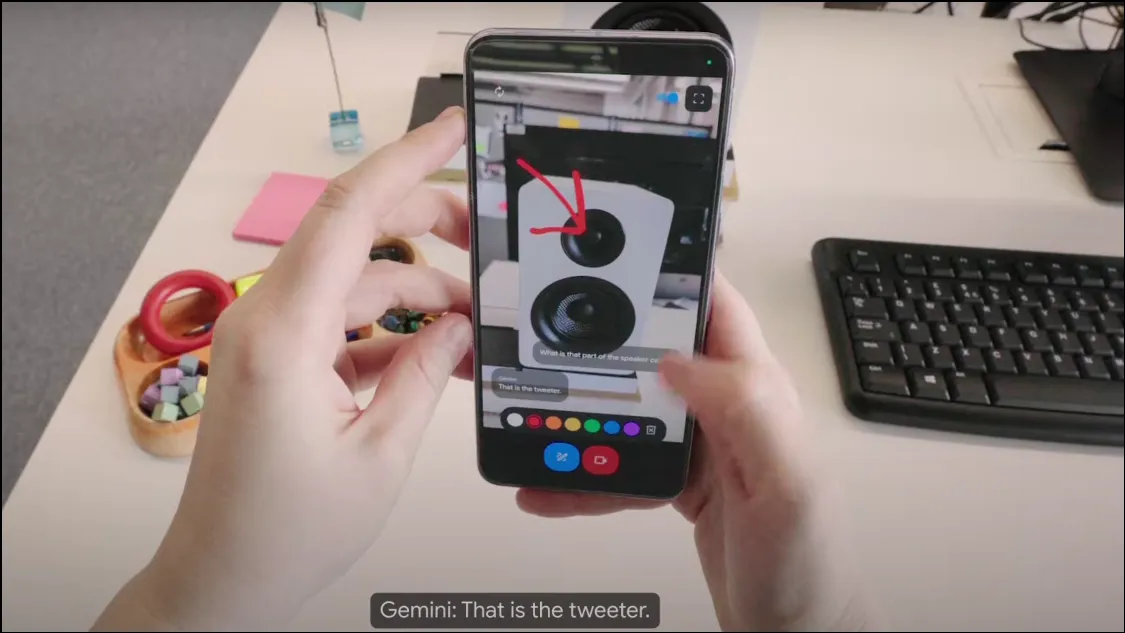

Visuelle evner

Ved at bruge kameraet på din smartphone kan Gemini Live optage videoer i realtid. Dette lader det identificere objekter og besvare spørgsmål vedrørende dem. For eksempel, hvis du peger dit smartphone-kamera mod en højttaler og beder Gemini om at identificere det, vil det fortælle dig, hvad det er og endda identificere dets mærke og model.

Hvordan fungerer Gemini Live?

Project Astra kan kombinere tale og visuelle input, hvilket gør dem nemme at forstå for AI-modellen. Den kan derefter reagere på oplysningerne og yde den nødvendige assistance. Ligesom OpenAIs GPT-4o-drevne ChatGPT er Gemini Live en multimodal AI og er ikke udelukkende afhængig af tekst som input.

Mens Gemini Live oprindeligt vil bruge stemmeinput til at indsamle og analysere data ved den første udgivelse, vil den blive opgraderet i de kommende måneder til også at behandle og analysere videoer ved at opdele dem ramme for ramme for bedre forståelse og interaktion.

AI’en kan tilpasse sig den hastighed, som forskellige brugere taler med, og du kan endda afbryde den for at bede om afklaring eller give flere oplysninger. Dens evne til at efterligne menneskelig dialog kan give en mere engagerende interaktion. Således kan du få en frem og tilbage-samtale med den, ligesom med en menneskelig assistent. Derudover vil du kunne vælge mellem ti forskellige stemmer til AI.

GPT-4o vs. Gemini Live

Selvom både GPT-4o og Gemini Live er multimodale AI-modeller, er det lige nu svært at se, hvilken der klarer sig bedre i det virkelige liv, især da ingen af dem er offentligt tilgængelige i øjeblikket.

Men i modsætning til ChatGPT er Gemini Live afhængig af andre AI-modeller som Google Veo og Imagen 3, for at levere output i form af videoer og billeder. På trods af dette virkede ChatGPT mere naturligt i de demoer, der blev vist af OpenAI og Google, og den nye GPT-4o-model kunne endda registrere og simulere menneskelige følelser gennem vokale toner.

Derudover kan den tilpasse sig den måde, du vil have den til at svare på, hvilket Gemini Live ikke kan, i det mindste i dens nuværende tilstand.

Gemini Live tilgængelighed

Gemini Live vil være tilgængelig for Gemini Advanced-abonnenter, som er den betalte version af AI-chatbot. Det vil blive rullet ud i de kommende måneder og forventes at være bredt tilgængeligt i slutningen af året.

Apps som Google Messages vil være i stand til at drage fuld fordel af Gemini Live, hvilket giver brugerne mulighed for at interagere med AI direkte i besked-appen.

Gemini Live kan være den næste store opgradering til Googles AI-chatbot, og lige hvad den har brug for for at tage imod rivaler som OpenAIs ChatGPT. Med multimodal funktionalitet og kraftfulde talefunktioner kan den opgraderede model hjælpe Google med at opnå succes med at levere en alsidig og pålidelig digital assistent.

Lige nu har Google kun annonceret, at det vil bringe den nye AI-model til betalte abonnenter. Selvom dette udelader gratis brugere, som udgør en stor del af Googles brugerbase, håber vi, at Google ændrer sin holdning og beslutter sig for at udvide tilgængeligheden af Gemini Live.

Skriv et svar