På sin årlige I/O-konference i Californien kom Google med adskillige meddelelser relateret til kunstig intelligens, herunder nye modeller og opgraderinger til eksisterende. En af de mest interessante meddelelser var Project Astra – en multimodal assistent, der fungerer i realtid og kombinerer evnerne fra Google Lens og Gemini for at give dig information fra dine omgivelser.

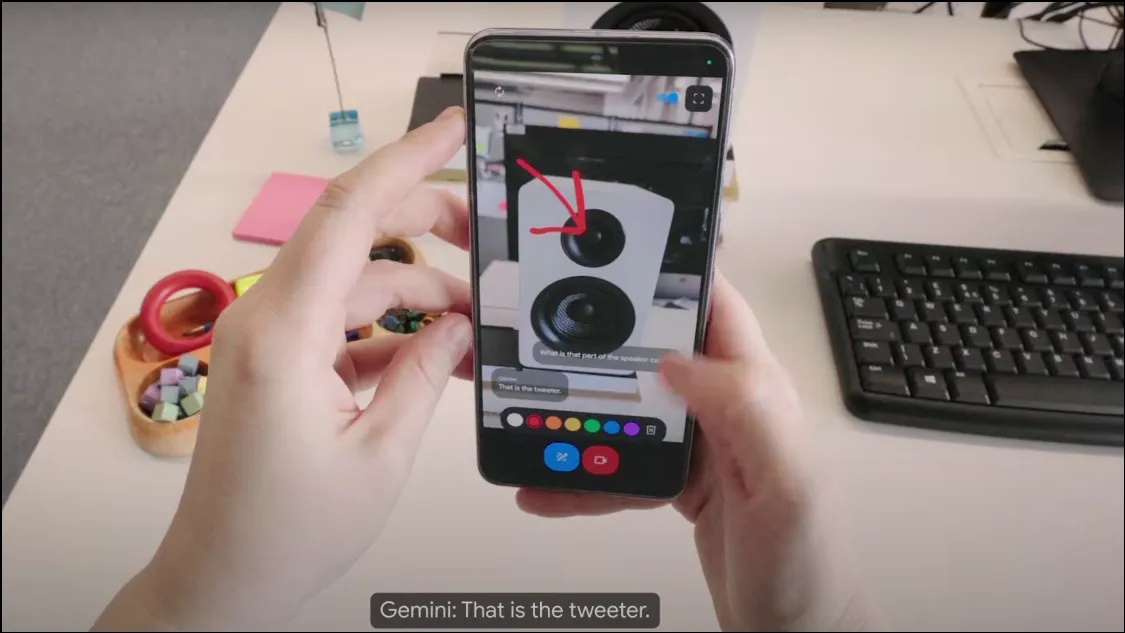

Hvordan fungerer Project Astra? På konferencen viste Google en tidlig version af Project Astra frem, der fungerer som en kamerabaseret chatbot og kan indsamle information fra dine omgivelser ved hjælp af kameraet på din enhed. Da den er en multimodal AI-assistent, kan den bruge lyd, video og billeder som input og levere det nødvendige output baseret på disse. Den kører på Gemini 1.5 Pro-modellen, hvilket gør den utrolig kraftfuld.

Chatbotten analyserer objekter og omgivelser i realtid og kan besvare forespørgsler meget hurtigt, hvilket gør den ret lig en menneskelig assistent eller Tony Starks elskede JARVIS. Project Astra arbejder også med wearables som smarte briller, hvilket betyder, at der er masser af potentiale for, at AI-chatbot kan integreres i forskellige enheder.

Project Astra kan bedre forstå den kontekst, det bliver brugt i, behandle information hurtigere og gemme det for hurtigere genkaldelse. Dens taleegenskaber er også meget forbedret sammenlignet med tidligere Gemini-modeller, så det lyder mere naturligt og menneskelignende.

Hvad kan Project Astra? I den korte demo, som Google viste frem, ser det ud til, at der er meget, som Project Astra kan hjælpe med at udrette. Den kan observere og forstå objekter og steder gennem kameralinsen og mikrofonen og give dig information om dem. For eksempel kan du bare rette din telefon mod et stykke kode og diskutere det med chatbotten, eller bede den om at identificere et objekt og dets brug.

På samme måde kan Project Astra, takket være placeringsbevidsthed, give information om din lokalitet blot ved at tage et kig på dine omgivelser. Det kan også gemme oplysninger, der vises til det, hvilket kan være ret praktisk, hvis du vil finde fejlplacerede genstande, som demonstreret i demoen, da det hjalp brugeren med at finde deres briller.

Du kan også bede AI-assistenten om kreative ideer, ligesom med Gemini på din telefon. For eksempel kan du bede den om at komme med tekster til en sang, et navn til et musikband eller noget andet. Grundlæggende sigter Project Astra efter at være en universel AI-assistent, der kan give dig information i realtid på en meget samtale måde.

Hvornår vil Project Astra være tilgængeligt? På nuværende tidspunkt har Google ikke udsendt meddelelser om tilgængeligheden af Project Astra. Den version, der er vist i demoen, er en tidlig prototype, men Google antydede, at disse muligheder kunne blive integreret i den eksisterende Gemini-app på et senere tidspunkt.

Med Project Astra stræber Google efter at lede udviklingen af AI-assistenter, så de bliver endnu mere nyttige og nemmere at bruge. Google er dog ikke den eneste, der forfølger dette mål. OpenAI annoncerede også for nylig GPT-4o, hvilket gør dens ChatGPT multimodal, hvilket forbedrer dens muligheder og effektivitet. ChatGPTs nye Voice Mode (frigives snart) kan også bruge videoinput fra enhedens kamera, mens den interagerer med brugere.

Lige nu er forskellen mellem de to, at GPT-4o snart vil være tilgængelig på alle enheder, der kører ChatGPT, mens Project Astra forventes at være tilgængelig som Gemini Live engang i fremtiden, selvom der ikke er nogen udgivelsesdato i øjeblikket. Da GPT-4o-drevet ChatGPT er tilgængelig tidligere, er det stadig at se, om Googles Project Astra vil være god nok til at konkurrere med OpenAIs mere populære chatbot.

Skriv et svar